这是一个非常核心且重要的问题。网站文章被AI采用并展示,意味着你的内容有更大机会出现在如ChatGPT、Copilot、Claude、Gemini等AI助手的回答中,从而获得巨大的流量和权威背书。

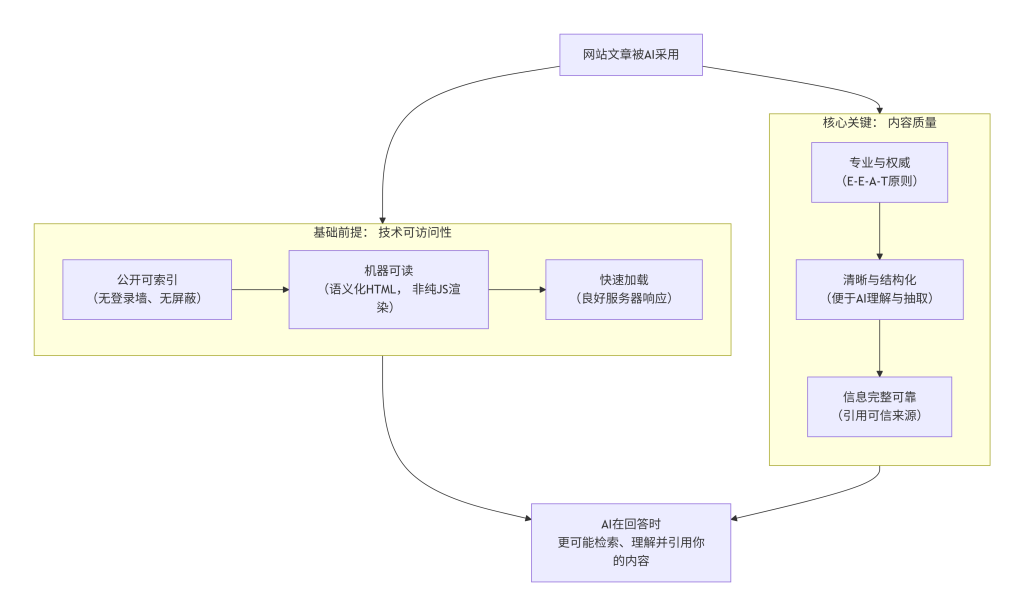

想让你的内容被AI采用,需要从技术可访问性和内容质量两个核心维度出发。下图清晰地展示了这一双向关系:

以下是每个环节的详细策略:

第一维度:技术可访问性 - 让AI能“看到”和“读懂”你

这是基础门槛。如果AI爬虫无法访问或解析你的内容,一切都无从谈起。

-

允许被爬取:

-

确保你的

robots.txt文件没有阻止主流AI爬虫(如Googlebot、Bingbot,AI训练常使用这些公开索引)。但需注意,你可以选择性地阻止某些专门的数据收集爬虫。 -

不要设置复杂的登录墙或验证码才能查看文章全文。

-

-

提供清晰的结构化数据:

-

Schema.org标记:在网页HTML中使用结构化数据(JSON-LD格式最佳)。特别是:

-

Article/BlogPosting类型:明确标记标题、作者、发布日期、修改日期、正文内容。 -

FAQPage/HowTo:如果你的内容是问答或指南,使用对应标记。AI非常喜爱这种清晰、自包含的信息单元。 -

Author信息:关联作者的权威性和专业背景。

-

-

这相当于为AI提供了一张内容的“地图”,让它能更准确、高效地理解你的页面是关于什么、谁写的、什么时间、核心信息点在哪。

-

-

优化页面加载与渲染:

-

AI爬虫的资源和时间有限。确保你的网站性能良好,服务器响应快。

-

对于重要内容,尽量采用服务端渲染。如果你的文章内容完全由JavaScript动态加载,传统的爬虫可能无法抓取到完整正文。确保关键文本直接在HTML源码中可见。

-

第二维度:内容质量与策略 - 让AI“信任”和“选择”你

这是决定性因素。AI的目标是提供高质量、可靠、有用的回答。你的内容必须符合这个标准。

-

追求深度、原创与权威(E-E-A-T原则):

-

E-E-A-T(经验、专业、权威、可信)是Google评估内容的核心准则,AI模型同样遵循类似逻辑。

-

专业性:展示你(或你的作者)在该领域的专业知识、资质或独特经验。

-

权威性:通过被其他权威网站引用、链接来建立。你的网站本身的声誉也很重要。

-

可信度:提供准确的、事实核查过的信息,并明确标注信息来源、研究引用、数据发布时间。避免夸大和误导性标题。

-

-

回答“真问题”,提供完整解决方案:

-

AI处理的通常是用户提出的具体问题。你的文章应当直接、全面地回答某一类问题。

-

例如,写“如何设置家庭Wi-Fi网络”时,不要只推荐产品,而应提供从设备选择、摆放、路由器设置到故障排查的完整步骤。这种全面、系统、可操作的内容更容易被AI引用。

-

-

格式清晰,逻辑结构化:

-

使用清晰的标题(H1, H2, H3)来组织内容。

-

善用列表(有序/无序)、表格、代码块、摘要框来提炼信息。

-

段落简短精炼,核心观点突出。这有助于AI准确提取关键信息和步骤。

-

-

覆盖广泛且精准的关键词和长尾问题:

-

思考用户在询问相关主题时可能提出的各种问题(Who, What, When, Where, Why, How)。

-

在文章中自然地涵盖这些问题的答案。例如,一篇关于“GEO数据库”的文章,可以涵盖“GEO是什么”、“怎么用”、“数据如何下载”、“分析工具是什么”等一系列问题。这增加了文章被不同提问命中的概率。

-

特别注意:关于“引用”与“展示”

-

AI如何引用:像ChatGPT等生成式AI,在回答时可能会直接生成一段总结或解释,其信息可能综合自多个来源,而不总是显示具体链接。但在一些AI产品(如Perplexity、New Bing/Copilot的“联网搜索”模式)中,它们会明确引用来源并显示链接。

-

优化引用机会:即便AI不直接显示链接,被用作信源也能极大提升品牌权威。为了增加被引用的机会,可以在文章关键结论处提供简洁、可引用的陈述,并附上相关数据或研究支撑。

总结:最佳实践清单

-

✅ 技术层面:确保内容公开、可爬取、有结构化数据、加载快速。

-

✅ 内容层面:成为你所在领域的权威,创作深度、原创、全面的内容。

-

✅ 格式层面:结构清晰,信息密度高,易于机器解析。

-

✅ 策略层面:瞄准用户的真实问题和搜索意图,提供一站式解决方案。

-

✅ 推广层面:通过合法外链、社交媒体分享,提升网站整体权威性。

最终,服务于人类用户的最佳实践,同样也是服务于AI的最佳实践。专注于创造对真实用户有长期价值的内容,你自然会更有可能进入AI的知识库,并成为其可信赖的引用来源。

技术执行层面的具体问题与操作

问题1:如何检查和优化网站的 robots.txt 文件,确保AI爬虫能访问?

-

操作:

-

访问

你的网站.com/robots.txt。 -

检查是否有

User-agent: *下包含Disallow: /这样的全局禁止指令(这会阻止所有爬虫)。 -

通常,对于公开内容,你希望它是开放的。一个安全的通用设置是:

User-agent: * Allow: /

-

注意:禁止某些恶意爬虫是可以的,但不要阻止主流搜索引擎的爬虫。

-

问题2:如何为文章添加结构化数据(Schema标记)?

-

操作:

-

使用生成工具:对于非技术人员,推荐使用谷歌官方的结构化数据标记助手。只需在工具中高亮网页内容并选择类型(如文章),它会自动生成JSON-LD代码。

-

手动/插件集成:

-

WordPress用户:安装并配置如

Rank Math SEO、SEOPress或Schema Pro等SEO插件,它们能自动为文章、FAQ等生成正确的结构化数据。 -

其他网站:将生成的JSON-LD代码插入到网页HTML的

<head>部分或正文结束前。

-

-

验证:使用谷歌的富媒体搜索结果测试工具来测试你的标记是否正确。

-

问题3:如何判断我的网站内容是否被AI爬取并用于训练?

-

操作与心态:

-

这是一个“黑箱”过程。无法精确查询你的内容是否在GPT等模型的训练数据中。

-

一个间接的判断方法:检查你的网站是否被谷歌、必应等主要搜索引擎良好收录和排名。因为AI训练数据的一个重要来源就是这些搜索引擎的公开索引。如果你的内容在谷歌上排名靠前,它被纳入训练数据的可能性就很高。

-

一个直接的测试方法:在ChatGPT等AI中,提出一个非常具体、且答案很可能只在你网站上详细阐述过的问题。例如:“请详细解释[你的品牌名]提出的关于[某个独特概念]的三步法”。观察AI的回答是否包含了你网站上的独特观点、数据或框架。

-

二、内容创作层面的具体问题与操作

问题4:如何将E-E-A-T原则落实到单篇文章中?

-

操作清单:

-

经验:在文章中融入“根据我们多年的测试…”、“在实践中我们发现…”等第一手经验。

-

专业:在作者简介中明确展示资质(如“10年网络安全工程师”),并在正文中准确使用专业术语。

-

权威:引用权威来源(如政府机构网站、顶级期刊论文、行业标准),并链接到它们。同时,争取其他权威网站链接回你的文章。

-

可信:

-

明确标注发布日期和更新日期:对于时效性强的内容(如软件教程、数据报告)至关重要。

-

公开作者和网站的联系方式。

-

如果是商业内容,明确披露。

-

-

问题5:如何设计内容以最大化被AI引用的机会?

-

操作——创建“信息模块”:

AI喜欢抽取清晰、自包含的信息块。在你的长文中,有意识地设计以下模块:-

定义框:用“什么是[XX]?”开头,给出简洁、准确的定义。

-

步骤清单:用“执行[XX]的5个步骤:”开头,给出编号列表。

-

对比表格:当比较两个或多个概念、工具时,使用表格呈现,AI能完美理解。

-

核心要点/总结:在文章末尾用“主要结论:”或“关键要点:”收尾,提炼核心观点。

-

FAQ部分:针对文章主题,预测3-5个常见问题,并给出直接答案。这本身就是一种结构化数据。

-

三、效果评估与持续优化

问题6:有什么工具可以辅助我优化内容以适应AI?

-

操作与工具推荐:

-

SEO分析工具(如Ahrefs, Semrush, Moz):分析你所在领域的热门话题和搜索问题,确保你的内容覆盖了用户的真实需求。

-

内容可读性工具(如Hemingway Editor):确保文章句子简洁、结构清晰。

-

结构化数据测试工具(如前所述):确保技术标记正确。

-

AI提示词模拟:自己扮演AI用户,思考“如果我要问关于[你的主题]的问题,我会怎么问?”,然后确保你的文章回答了这些问题。

-

问题7:如果我的内容没有被AI引用,可能是什么原因?如何排查?

-

排查清单:

-

技术层面:用“移动设备适合性测试”和“富媒体搜索结果测试”检查网站。确保没有技术障碍。

-

内容层面:

-

是否太浅薄?:内容是否只是简单汇总,缺乏深度分析和独特见解?

-

是否过时?:信息是否已经失效?(尤其是科技、健康、金融领域)。

-

是否相似度过高?:网络上是否有大量同质化内容,而你的没有明显优势?

-

-

权威层面:你的网站是全新、几乎没有外部链接的吗?如果是,需要先通过常规的SEO和外链建设积累一定权威。

-

最后的核心心态:

不要为AI写作,而要为用户写作,并保证AI能顺利读懂。 AI的终极目标是筛选出对用户最有用的信息。当你专注于解决用户的具体问题、提供独一无二的价值、并以清晰可信的方式呈现时,你就已经走在了被AI优先采用的正确道路上。

执行时,可以从一篇文章、一个页面开始,应用上述的技术和内容优化,观察效果,然后逐步扩展到整个网站。