Google快速收录终极执行手册:从原理到实操的深度指南

第一部分:重塑认知——理解收录背后的“爬虫心理学”

Googlebot不是机器,而是一支具备经济思维的智能采集队伍。它的核心决策逻辑基于 “信任投资回报率”:

高价值信号 → 更高信任度 → 更多抓取预算 → 更快收录速度

本指南将围绕这一核心逻辑,构建可立即执行的系统化操作方案。

第二部分:四阶加速执行框架

第一阶段:技术奠基(24小时内完成)

操作1:搭建Googlebot无障碍通道

执行清单:

-

GSC验证与配置

-

通过域名提供商DNS验证(最权威方式)

-

验证所有网站版本(http/https, www/non-www)

-

在“设置”中提交首选域名

-

-

爬虫友好度即时检测

# 使用curl模拟Googlebot访问测试 curl -A "Googlebot" -I https://你的网站.com # 检查返回状态码是否为200 # 检查响应头是否包含屏蔽指令(x-robots-tag)

-

站点地图动态生成策略

-

安装XML Sitemap插件或生成器(推荐:Yoast SEO、XML Sitemaps)

-

配置自动包含:新文章立即加入,旧文章按权重筛选

-

分割策略:

-

sitemap-posts.xml(文章类) -

sitemap-pages.xml(页面类) -

sitemap-products.xml(产品类) -

sitemap-videos.xml(视频内容)

-

-

-

关键提交操作(同步执行)

-

登录Google Search Console

-

左侧菜单选择“站点地图”

-

输入

sitemap_index.xml(如有分地图)或sitemap.xml -

点击“提交”

-

立即执行Ping操作:

https://www.google.com/ping?sitemap=https://你的网站.com/sitemap.xml

-

第二阶段:内容信号强化(发布前准备)

操作2:创建“不可忽视”的内容模板

文章类内容标准模板:

# 主标题(包含核心关键词,但以解决问题为导向) ## 前言:明确用户痛点 - 使用“你是否遇到过...”等共鸣句式 - 数据支持:引用行业报告最新数据(202X年) - 本文价值预告:明确告诉读者将获得的具体解决方案 ## 核心内容(E-E-A-T体现区) ### 1. 经验分享区 - [插入实践过程截图/原始数据表] - “我们在实际测试中发现...”(第一人称叙述) - 失败案例与教训(真实性构建信任) ### 2. 专业性证明区 - [作者]:从事本领域[X]年,曾主导[具体项目] - 本领域相关认证:[附证书截图或链接] - 参考标准:[引用行业权威标准,如RFC、ISO等] ### 3. 权威性背书区 - “根据[X]大学最新研究显示...”(附引用链接) - 行业专家观点:[引用并链接到权威网站访谈] - 相关统计数据:[使用权威机构数据,如Statista、艾瑞咨询] ### 4. 可信度构建区 - 文章最后更新时间:[使用ISO 8601格式:2024-01-20T15:30:00+08:00] - 作者联系方式:[专业邮箱/领英主页] - 内容更新记录:[如有重大更新,列出日期和修改内容]

操作3:发布前技术检查清单

-

页面速度预检(目标:移动端LCP<2.5秒)

-

使用PageSpeed Insights测试

-

压缩图片至WebP格式(工具:Squoosh)

-

延迟加载非首屏图片和视频

-

-

结构化数据部署

-

根据内容类型选择Schema标记:

-

文章:

Article -

产品:

Product -

本地商家:

LocalBusiness

-

-

使用Google结构化数据测试工具验证

-

-

移动端适配验证

-

Chrome开发者工具设备模拟测试

-

确保触摸目标尺寸≥48px

-

确保字体大小≥16px(避免缩放)

-

第三阶段:发布时立即触发操作

操作4:多通道同步推送(60分钟内完成)

执行流程:

发布新内容 → 触发自动化工作流 → 全渠道广播

具体操作步骤:

-

API推送(最高优先级)

-

适用于技术团队:配置CMS发布钩子,自动调用Indexing API

-

手动推送备选方案:使用Python脚本

import requests import json # 配置参数 API_URL = "https://indexing.googleapis.com/v3/urlNotifications:publish" ACCESS_TOKEN = "你的GSC API令牌" NEW_URL = "https://你的网站.com/新页面" headers = { "Content-Type": "application/json", "Authorization": f"Bearer {ACCESS_TOKEN}" } payload = { "url": NEW_URL, "type": "URL_UPDATED" } response = requests.post(API_URL, headers=headers, data=json.dumps(payload)) print(f"API响应: {response.status_code}")

-

-

GSC手动提交(备用通道)

-

进入GSC → URL检查工具 → 输入新URL → 请求编入索引

-

批量提交技巧:每周一整理上周所有新URL,使用GSC的“网址前缀”功能批量提交

-

-

内链即时植入

-

首页最新内容模块(确保在首屏)

-

相关文章内链(至少3处)

-

网站主导航“最新动态”栏目(如有)

-

-

社交信号触发

Twitter发布模板: 🚀 新发布:[文章标题] 💡 核心价值:[用一句话说明解决什么问题] 🔗 直达链接:[短链接] 📌 相关话题:#行业话题 @相关专家 LinkedIn发布模板: 更专业的语气,侧重行业洞察和解决方案 添加“文章”标签,链接到公司页面

第四阶段:发布后信任度加速

操作5:链接引导策略(72小时内)

外链获取优先级矩阵:

| 优先级 | 链接类型 | 获取策略 | 预期效果时间 |

|---|---|---|---|

| P0 | 行业权威站引用 | 内容合作、专家采访、数据引用 | 1-2周 |

| P1 | 高质量目录提交 | 提交至专业目录(如Product Hunt) | 3-7天 |

| P2 | 论坛深度回答 | 在Stack Overflow等论坛回答相关问题时自然引用 | 1-4周 |

| P3 | 社交书签 | Reddit相关板块、Hacker News | 1-3天 |

内链优化操作:

-

使用Screaming Frog抓取网站,找出“孤岛页面”(无内链指向)

-

在相关高权重页面中添加至新内容的内链

-

创建“相关内容”模块,算法推荐相关新文章

第三部分:监控与诊断系统

操作6:建立收录速度监控仪表板

GSC数据追踪点:

-

发现时间:URL首次出现在GSC的时间

-

首次抓取:爬虫首次访问时间戳

-

索引状态:进入索引的时间

-

覆盖率变化:每日新增索引URL数

使用Google Sheets自动化监控:

// 通过GSC API获取最新数据(需要设置定时任务) function fetchIndexingData() { // 连接GSC API // 提取:提交的URL数、已索引URL数 // 计算:收录率 = 已索引/提交总数 // 计算:平均收录时间 = (索引时间-提交时间)的平均值 }

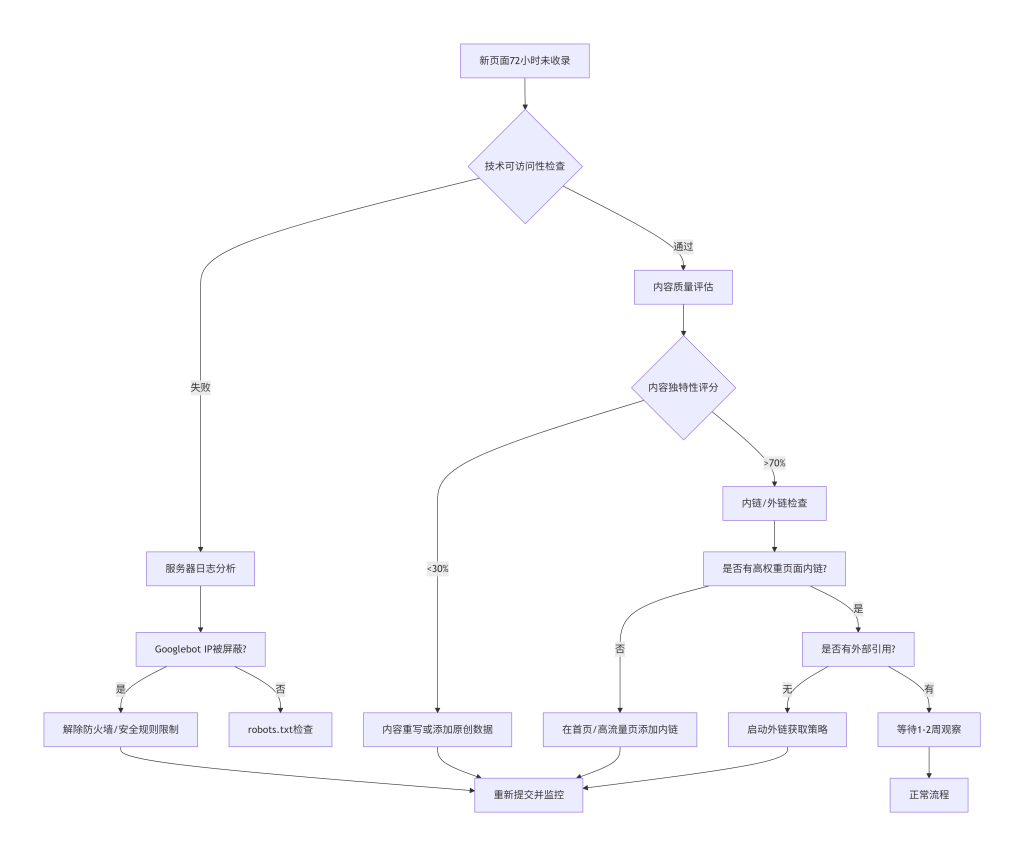

操作7:收录延迟诊断流程图

第四部分:特殊场景优化策略

场景1:新网站加速方案

第一个月执行日历:

| 周期 | 核心任务 | 关键指标 |

|---|---|---|

| 第1周 | 技术完美化+5篇标杆内容 | 所有页面可抓取 |

| 第2周 | 获取3个高质量外链+社交推广 | 首页被收录 |

| 第3周 | 发布10篇相关内容+内链优化 | 30%页面被收录 |

| 第4周 | 第一次内容更新+外链拓展 | 收录率>50% |

场景2:电商网站批量产品页

优化公式:

收录概率 = (模板差异化程度 × 内链权重) / (重复内容比例)

具体操作:

-

模板差异化:每10个产品生成1个对比指南页面

-

分批次上线:每天发布不超过50个新产品,避免被判断为低质量批量内容

-

用户生成内容整合:鼓励评论,并在产品页展示精选评价

场景3:新闻/时效性内容

极速收录工作流:

记者撰稿 → 编辑器审核 → 发布 → API推送 → Twitter公告 → 监控收录状态

↓ ↓

预填充GSC表单 15分钟后检查索引

第五部分:长期信任度维护

操作8:建立爬虫关系维护日历

每月固定操作:

-

第一个周一:分析上个月服务器日志,调整爬虫预算分配

-

第二个周一:更新站点地图,移除过期URL

-

第三个周一:更新10篇旧文章(添加新数据、案例)

-

第四个周一:外链健康度检查(使用Ahrefs或SEMrush)

每季度深度操作:

-

网站架构审查:点击深度、内部权重分配

-

内容差距分析:与排名前3竞争对手对比

-

收录模式分析:识别未被收录的高价值内容类型

终极认知:从“追求收录”到“值得收录”

真正的快速收录不是技术上的“欺骗”或“催促”,而是当你的网站成为Googlebot最信任的信息源时自然发生的结果。这套执行方案的核心逻辑是:

提供无可替代的价值 → 建立技术上的无障碍通路 → 主动展示你的价值 → 获得信任优先权

开始执行前,请记住这个优先级:

-

价值 > 技术 > 提交:没有价值的内容,再好的技术也无法获得长期快速收录

-

系统 > 单点:建立持续的内容生产和优化系统,而非偶尔的优化

-

数据 > 直觉:所有决策基于GSC数据和日志分析

现在,从第一阶段技术奠基开始,每一步操作都记录时间和结果。30天后,你不仅会获得更快的收录速度,更重要的是构建了一个Google主动信赖、用户持续喜爱的网站生态系统。这正是搜索可见性的真正基石。